Avaliação Baseada em Métricas

Disponível nos planos Pro e Enterprise

A avaliação baseada em métricas está disponível nos planos Pro e Enterprise. Usuários registrados da comunidade e usuários do plano Starter também podem usá-la em um único workflow.

O que é uma avaliação baseada em métricas?

Quando seu workflow estiver pronto para implantação, você normalmente desejará testá-lo com mais exemplos do que durante a fase de construção.

Por exemplo, quando execuções em produção começarem a revelar casos extremos (edge cases), você provavelmente vai querer adicioná-los ao seu conjunto de dados de teste para garantir que todos sejam cobertos.

Com conjuntos de dados grandes construídos a partir de dados reais de produção, é difícil avaliar o desempenho geral apenas observando os resultados visualmente. É necessário medir o desempenho de forma quantitativa. A avaliação baseada em métricas atribui uma ou mais pontuações a cada execução de teste e permite compará-las com execuções anteriores. Cada pontuação individual é agregada para medir o desempenho geral no conjunto completo de dados.

Essa funcionalidade permite executar avaliações com métricas calculadas, rastrear como essas métricas mudam entre diferentes execuções e investigar as causas dessas mudanças.

As métricas podem ser funções determinísticas (como a distância de edição entre duas strings) ou podem usar inteligência artificial (IA) para cálculo. Geralmente, as métricas envolvem comparar a saída gerada com uma saída de referência (também chamada de ground truth). Para isso, o conjunto de dados deve conter essa saída de referência. No entanto, algumas avaliações não exigem uma saída de referência (por exemplo, verificar o sentimento ou conteúdo prejudicial em um texto).

Como funciona

Sobre credenciais do Google Sheets

As avaliações usam tabelas de dados ou Google Sheets para armazenar conjuntos de dados de teste. Para usar o Google Sheets como fonte de dados, configure as credenciais do Google Sheets.

- Configure uma avaliação lightweight

- Adicione métricas ao seu workflow

- Execute a avaliação e visualize os resultados

1. Configurar uma avaliação lightweight

Siga as instruções de configuração para criar um conjunto de dados e conectá-lo ao seu workflow, escrevendo a saída de volta no conjunto de dados.

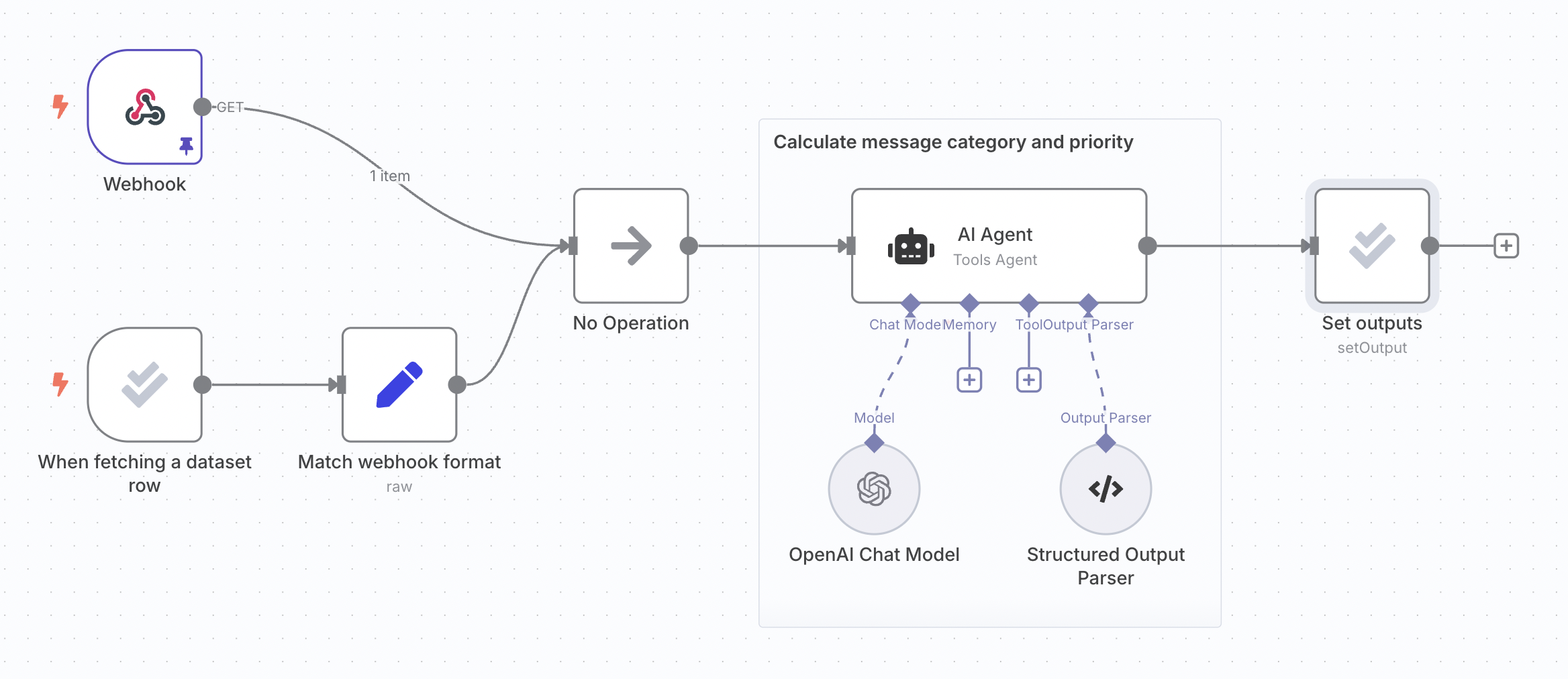

As etapas a seguir usam o mesmo exemplo de workflow de classificação de tíquetes de suporte descrito na documentação de avaliações lightweight:

2. Adicionar métricas ao workflow

Métricas são dimensões usadas para pontuar a saída do seu workflow. Normalmente, comparam a saída real do workflow com uma saída de referência. É comum usar IA para calcular métricas, mas às vezes também é possível calculá-las diretamente por meio de código. No n8n, as métricas sempre são numéricas.

Você precisa adicionar a lógica de cálculo das métricas em algum ponto do workflow após a geração da saída. Qualquer saída de referência usada pelas métricas pode ser incluída como uma coluna no conjunto de dados, garantindo que esteja disponível no workflow (já que o gatilho de avaliação envia o conteúdo do conjunto de dados para o workflow).

Use a operação Set Metrics (Definir Métricas) para calcular as seguintes métricas:

- Correctness (Correção, baseada em IA): A resposta tem o mesmo significado da resposta de referência? Usa uma escala de 1 a 5, sendo 5 a melhor pontuação.

- Helpfulness (Utilidade, baseada em IA): A resposta atende à pergunta feita? Usa uma escala de 1 a 5, sendo 5 a melhor pontuação.

- String Similarity (Similaridade de Strings): Quão próxima a resposta está da resposta de referência, medida caractere por caractere (distância de edição). Retorna uma pontuação entre 0 e 1.

- Categorization (Classificação): A resposta corresponde exatamente à resposta de referência? Retorna 1 se houver correspondência exata, caso contrário retorna 0.

- Tools Used (Ferramentas Utilizadas): A execução utilizou alguma ferramenta? Retorna uma pontuação entre 0 e 1.

Você também pode adicionar métricas personalizadas: calcule a métrica dentro do workflow e mapeie-a para o nó de avaliação. Use a operação Set Metrics e selecione Custom Metrics (Métricas Personalizadas), depois defina o nome e o valor da métrica a ser retornada.

Exemplo:

- Relevância de Documentos em RAG (Retrieval-Augmented Generation): Ao usar um banco de dados vetorial, os documentos recuperados são relevantes para a pergunta?

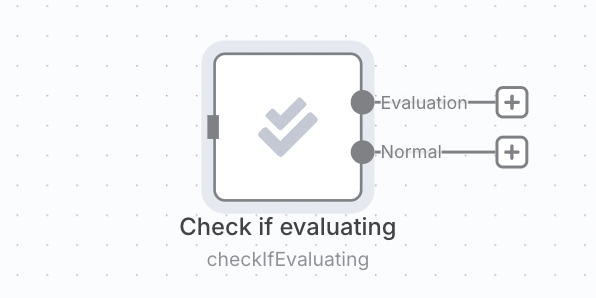

O cálculo de métricas aumenta a latência e o custo, portanto talvez você queira calculá-las apenas durante avaliações e ignorá-las nas execuções de produção. Para fazer isso, posicione a lógica das métricas após a operação "Check if Evaluating" (Verificar se está avaliando).

3. Executar a avaliação e visualizar os resultados

Vá para a aba Evaluation (Avaliação) do seu workflow e clique no botão Run evaluation (Executar avaliação). A avaliação será iniciada. Após a conclusão, serão exibidas as pontuações agregadas para cada métrica.

Você pode clicar em uma linha de execução de teste para ver os resultados de cada caso de teste individual. Clicar em um caso específico abrirá o registro da execução que gerou aquele resultado (em uma nova aba).